Вдохновившись переводами

статей на тему Organizational

Network Analysis и

постом Эдуарда Бабушкина про работукоманды, я решила попробовать провести организационный сетевой анализ в R на реальных данных о коммуникации

коллектива.

Поскольку мессенджеры нынче

наше всё, источником информации стала переписка в рабочем чате Telegram одного

профессионального коллектива. Мессенджер является официальным корпоративным средством связи компании, чат используется как для решения рабочих вопросов

(около 70% сообщений), так и внерабочих (например, совместно заказать пиццу). В

выборку не включались информационные сообщения «для всех» (учитывались только

ответные сообщения на них).

Про извлечение этих данных писать

особо нечего – в этом деле либо мозги и знание методов парсинга данных из мессенджеров,

либо железная… точка опоры :) Я пошла по второму пути – вручную выписала

информацию о переписке за 2 месяца. Зато теперь есть понимание возможных

сложностей: было бы интересно посмотреть, как при парсинге решается проблема с определением

направления сообщения (кому писалось), или проблема с участниками, которые

любят единый по смыслу месседж разбивать на несколько сообщений…

Итак, первое, что мы можем

сделать, это построить общую картину

коммуникаций в коллективе.

Красиво?... Даже визуально

заметно, что лидерами по частоте коммуникаций являются сотрудники 11, 15, 5, 10.

Первое, что можно предположить, что это - руководители, и на их сообщения остальные обязаны (либо просто

считают необходимым) отреагировать. Я

отметила руководителей красным цветом, и стало понятно, что это предположение

не вполне соответствует действительности. Я также отметила квадратом рядового

сотрудника, на которого возложены функции «организатора».

Таким образом, есть еще как

минимум два специалиста, которые не являются ни руководителями, ни

организаторами, но демонстрируют не меньшую частоту коммуникаций.

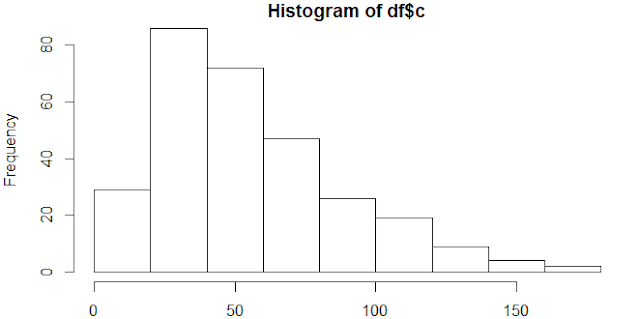

Для наглядности, мы можем

представить активность коммуникаций,

вот так:

Активность: суммарное

количество сообщений сотрудника и откликов на его сообщения.

Мы видим явно выбивающихся в

лидеры не-руководящих 11 и 5. Может, они

просто злостные спамеры и генерят поток ненужных картинок с котиками? Можем

разбить показатель активности на исходящий

(Out) и

входящий поток (In) (в

% соотношении):

Сотрудник 11 в равной

степени одинаково генерит контент и получает отклики, у номера 5 преобладают

исходящие, откликов явно меньше.

Вопрос

для размышления: можно ли сделать вывод, что сотрудник 11, конкурирующий по

активности (в том числе реакциям коллег), с руководством – является неформальным

лидером?

Также обращают на себя

внимание сотрудники с крайне низким уровнем общей

активности: 22, 24.

Опять

вопрос: можно ли предположить, что эти сотрудники испытывают сложности с

коммуникацией и обладают невысоким социальным статусом? (Хотя я бы проверила влияние стажа работы, возможно, это

просто новички).

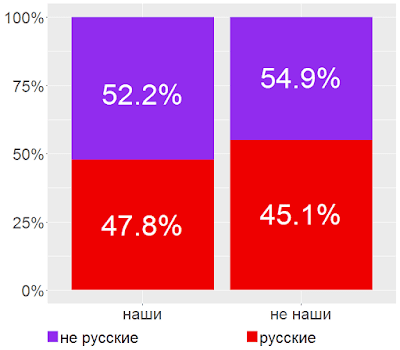

Еще один интересный разрез - разделение по группам внутри коллектива. Данный

конкретный коллектив функционально разделен на несколько отделов. Можно

посмотреть, как строятся коммуникации

внутри и между отделами:

Цветом выделены 4

функциональных отдела: «желтый» – сотрудники 1(руководитель), 2, 9, 23, «розовый»

– сотрудники 7(руководитель), 13, 21, «зеленый»

- одинокий сотрудник 8, «бирюзовый» - все остальные.

Можно заметить, что большую

часть коммуникаций создают сотрудники «бирюзового» отдела. Остальные слабо

вовлечены в общие коммуникации, в основном через одного участника: «розовый» через сотрудника 13, «желтый» - через 23. Руководители обоих

отделов, видимо, вообще предпочитают другие формы общения (возможно, через

личные сообщения или устно). При этом, между собой внутри желтый и розовый отделы

также общаются слабо, что убеждает меня в наличии альтернативного канала

коммуникаций (отдельный чат).

И вновь вопрос

для размышления: может ли эта картина отражать сплоченность всего

коллектива, качественно характеризовать межгрупповые отношения? Например, что

отделы не очень дружат между собой?

Вот еще несколько описательных

характеристик сети, которые могут понять ситуацию в коллективе (вообще,

параметров еще множество, я честно беру наиболее понятные для меня, как для

новичка в анализе сетей).

Транзитивность (коэффициент кластеризации) - характеристика

повышенной вероятности связи между двумя участниками коммуникации, если есть

одинаковые связи с другими участниками (друг моего друга – мой друг). Когда

коэффициент кластеризации высокий – это означает, что коммуникации чрезвычайно

плотно сгруппированы вокруг нескольких участников; когда он низкий – это

значит, что связи в графе относительно равномерно распространены среди всех

узлов.

[1] 0.473301

На мой взгляд,

коэффициент подтверждает картинку, полученную выше – коммуникации сгруппированы

вокруг части сотрудников одного отдела, за его пределами плотность заметно

падает.

Диаметр - максимальный кратчайший путь между любыми

двумя вершинами (между которыми такой путь возможно проложить). Параметр, который

показывает величину сети. 4 - много это

или мало, и какие выводы из этого можно сделать – я пока не могу предположить,

не хватает опыта, сравнить не с чем

(если у вас есть идеи – велком!)

[1] 4

Плотность - вычисляется как нормированное число ребер

(отношение наличных связей в сети к возможному максимальному количеству связей

в сети с данным количеством вершин).

[1] 0.548913

Взаимность – думаю, понятно из названия. В нашем случае

большинство связей оказываются взаимными. Предполагаю, что это хорошо для коллектива.

[1] 0.660066

Средняя длина пути – аналогично, определение очевидно. Среднее

количество точек между двумя вершинами.

[1] 1.853755

На мой неопытный взгляд большинство параметров середина на половинку. Не плохо, но и не

идеально.

Итак, главные вопросы к экспертному сообществу (и не к

экспертному тоже – даже если вы никогда этим не занимались, давайте в режиме

мозгового штурма):

1. Можно ли

использовать такую информацию, как коммуникации в чате Telegram для

социометрического анализа, в частности, определения звезд и аутсайдеров, оценки

социально-психологического климата или других прикладных hr-целей?

2. Какие

выводы сделали бы вы, глядя на полученную информацию?